Partnerprojekte

Das ursprünglich im DLR initiierte Backbone Projekt A.H.E.A.D. wird in der kontinuierlichen Erweiterung und Ergänzung der Idee, ferngesteuerte Hilfslieferfahrzeuge mit Technologien aus der Raumfahrtforschung in einen anwendungsrelevanten Demonstrator zu transferieren, durch externe Förderprojekte unterstützt. Alle diese Projekte zielen auf Detailaufgaben und Lösungen ab, welche im jeweiligen Kontext und bezogen auf die Partner, ermöglichen, die Technologie auf ein relevantes TRL hin zu einer Einsatzdemonstration im ersten Zielanwendungsgebiet, im Südsudan, vorzubereiten.

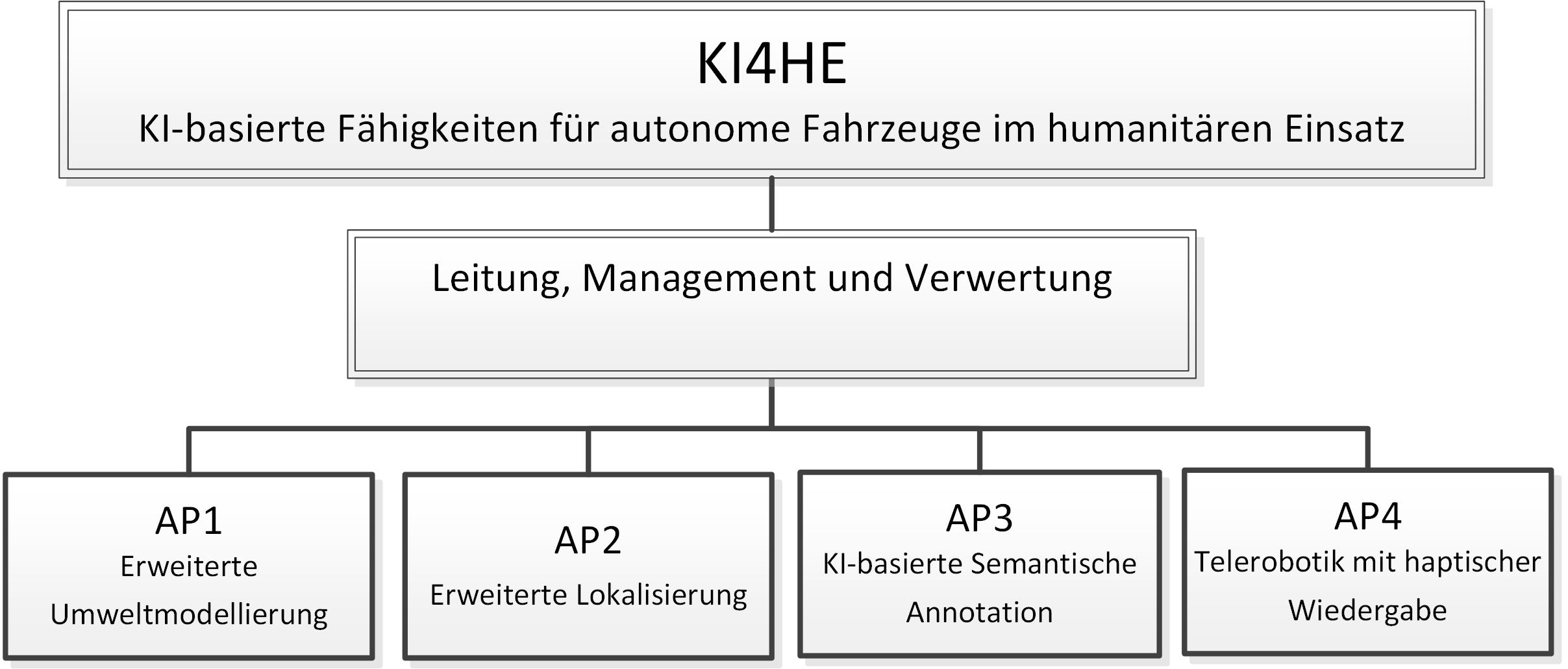

Projekt-1: KI4HE

KI4HE – KI-basierte Fähigkeiten für autonome Fahrzeuge im humanitären Einsatz

Das Projekt KI4HE ist ein Förderprojekt im Rahmen der Strategie BAYERN DIGITAL, bzw. des FuE-Programm „Informations- und Kommunikationstechnik“ des Freistaates Bayern aus dem StMWi. Der Projektträger ist die VDI/VDE Innovation + Technik GmbH.

Laufzeit: 1.12.2021 – 30.11.2024

Budget: 1 Mio. €

Bei den technischen Arbeitspaketen aus dem KI4HE Projekt handelt es sich um Erweiterungen von vier der fünf Technologie-Arbeitspakete aus dem A.H.E.A.D. Antrag, dennoch ist eine klare Abgrenzung der Arbeiten vorgesehen.

Die folgenden Arbeitspakete werden bearbeitet:

- Erweiterte Umweldmodellierung

- Erweiterte Lokalisierung

- KI-Basierte semantische Annotierung

- Telerobotik mit haptischer Wiedergabe

Diese vier technischen Arbeitspakete behandeln Kernthemen, die für die Automatisierung/Teleoperation des Verkehrs der Zukunft in unstrukturierten Umgebungen von hoher Relevanz sind. So werden im KI4HE Projekt Lösungen unter der Nutzung von intelligenten algorithmischen Anwendungen geschaffen.

Partner:

Der Partner Roboception GmbH wird im Rahmen des Projekts seinen Ansatz der visuellen Odometrie aus dem rc_visard in Richtung einer 360° abdeckenden Odometrie

weiterentwickeln. Diese Odometrie wird um ein neuartiges 360° 3D Umgebungsmodelle erweitert, das sowohl KI-basierte semantische Annotation ermöglicht als auch Schnittstellen für den teilautonomen Betrieb im Falle der Fernsteuerung zulässt. Die Kombination von KI-basierten und klassischen Methoden ermöglicht ein robustes und

zuverlässiges Navigationskonzept für vollständig unstrukturierte Umgebungen.

Der Partner DLR ist im KI4HE Projekt mit zwei Instituten vertreten, dem Institut für Robotik und Mechatronik (DLR-RM) und dem Institut für Kommunikation und Navigation (DLR-KN). Das Institut RM beteiligt sich als Projektleiter an allen Arbeitspaketen. DLR-KN, mit dem Schwerpunkt auf Umweltwahrnehmung, Semantischer

Annotierung und Teleoperation konzentriert sich das auf die Lokalisation und die damit verbundenen intelligente GNSS Fusion und Berechnung.

Der Assoziierten Partner „WFP Incubator Munich“ unterstützt das Projekt mit der Spezifikation des Anwendungsscenarios und kann für das KI4HE Projekt insbesondere bei der späteren Verwertung eine große Rolle spielen.

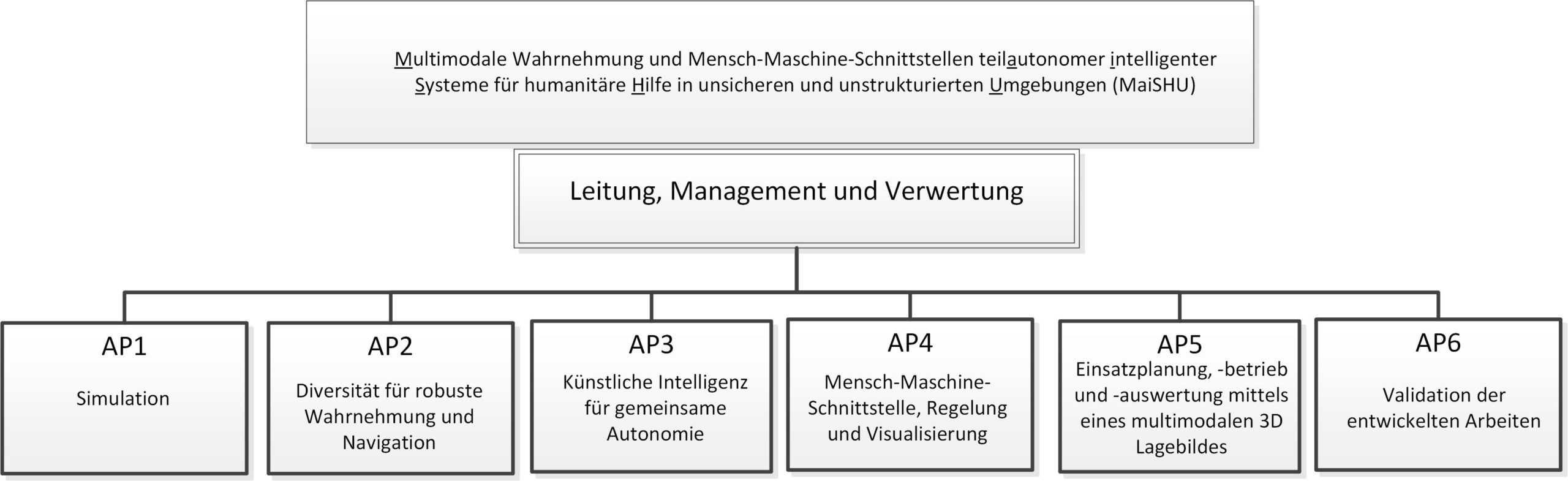

Projekt-2: MaiSHU

MaiSHU – Multimodale Wahrnehmung und Mensch-Maschine-Schnittstellen teilautonomer intelligenter Systeme für humanitäre Hilfe in unsicheren und unstrukturierten Umgebungen

Das Projekt MaiSHU ist ein Förderprojekt im Rahmen der Strategie BAYERN DIGITAL, bzw. des FuE-Programm „Informations- und Kommunikationstechnik“ des Freistaates Bayern aus dem StMWi. Der Projektträger ist die VDI/VDE Innovation + Technik GmbH.

Laufzeit: 1.01.2022 – 31.12.2024

Budget: 2 Mio. €

MaiSHU zielt darauf ab, innovative Technologien zu entwickeln, die eine assistierte Teleoperation von Fahrzeugen für die humanitäre Hilfe und Lieferung von Gütern in herausfordernden, unstrukturierten Umgebungen ermöglichen. Kern des Projekts ist die funktionale Integration einer robusten multimodalen Wahrnehmungsstrategie, ergänzt durch ein KI-gestütztes semantisches Umgebungsverständnis, und einer leistungsfähigen Mensch-Maschine-Schnittstelle, um dem Bediener die zuverlässige Fernsteuerung von Fahrzeugen zu ermöglichen. Basierend auf Satellitenbildern sowie Fahrzeug- und Wahrnehmungsdaten liefert ein globales Kontrollzentrum High-Level-Routenpläne, um die sichere Durchfahrbarkeit rauen Geländes zu gewährleisten. Die in diesem Projekt entwickelten Technologien ergänzen aktuelle Entwicklungen im Bereich des autonomen Fahrens auf Straßen und erlauben hohe Technologie-Reifegrade (TRL) für ihre zukünftige Kommerzialisierung für vielfältige Mobilitätsaufgaben in teil- bzw. unstrukturierten Außengeländen.

Die Arbeiten teilen sich auf folgende Arbeitspakete auf:

- Simulation

- Diversität für robuste Wahrnehmung und Navigation

- Künstliche Intelligenz für gemeinsame Autonomie

- Mensch-Maschine-Schnittstelle, Regelung und Visualisierung

- Einsatzplanung, -betrieb und -auswertung mittels eines multimodalen 3D Lagebildes

- Validation der entwickelten Arbeiten

Die methodischen und technologischen Entwicklungen werden in kontinuierlichen Simulationen getestet und in einer gemeinsamen Demonstration evaluiert.

Partner:

Die Forschungspartner DLR-RM und Blickfeld GmbH untersuchen gemeinsam die Nutzung von neuartigen Solid State Laser Systemen (LiDAR). Durch den Verzicht von beweglichen Teilen sind solche LiDARs kostengünstiger und auch robuster gegenüber Erschütterungen, weshalb sie für den skizzierten Einsatzbereich geeignet sind. Hierbei werden neben der Komplementarität des Lasersensors zu den bereits vorhandenen Kamerasystemen auch Aspekte wie die Modellierung, Kalibrierung, Registrierung und die Integration der Systeme in eine Simulationsumgebung untersucht, sowie die 360° Laserumweltwahrnehmung in Tests validiert.

Die Forschungspartner DLR-RM und SENSODRIVE GmbH untersuchen die Modalitäten einer erweiterten Mensch-Maschine-Schnittstelle, welche durch intelligente Algorithmen und Nutzung von „Konfidenz“-Informationen der gesamten verarbeiteten Sensorinformationen über haptische und visuelle Schnittstellen dem Tele-Operateur einen fließenden Übergang von direkter Fernsteuerung bis hin zu teilautonomen bzw. augmentierten Assistenzfunktionen bereitstellt. Die Erweiterung des Zugriffs auf die Gangschaltung bzw. die Schalterpanele des Fahrzeuges ermöglichen die Nutzung bei höheren Geschwindigkeiten.

Die Forschungspartner DLR-DFD, im Detail das ZKI (Zentrum für satellitengestützte Kriseninformation), und das WFP entwickeln Methoden zur Erweiterung der globalen Missionsplanung und der dreidimensionalen Lagedarstellung und -bewertung. Hierzu werden im globalen Kontrollzentrum (GMOC) hochauflösende Satellitenbilder sowie lokale Drohnen-Daten in einem 3D Lagebild dargestellt und zusammen mit weiteren gesammelten Geoinformationen in Form eines „Dashboards“ an das lokale Steuer- und Kontrollzentrum (LMOC) kommuniziert, um den Operateur zu unterstützen. Durch verschiedene Modalitäten der Daten wird bereits im Vorfeld die Konfidenz des geplanten Weges erhöht. Die Planung, Vorauswertung und Live-Bewertung werden durch intelligente Algorithmen, z.B. KI-basierte Hochwasserdetektion, sowie durch das operationelle Expertenwissen des WFPs kontinuierlich unterstützt. Eine dreidimensionale Aufbereitung aller verfügbaren Geodaten nach der Fahrzeugmission erlaubt eine detaillierte Beurteilung und Bewertung sowohl rückblickend betrachtet als auch zur Vorbereitung neuer Einsätze und zur Verbesserung der eingesetzten Methoden.

Projekt-3: MUSERO

MUSERO – Multisensor Roboter für die Erkundung in Krisenszenarien (MuSeRo)

Das Projekt MUSERO ist ein Förderprojekt im Rahmen der DLR internen FuE finanzierten Impulse aus dem Jahre 2023

Laufzeit: 1.01.2023 – 31.12.2025

Budget: 500 k€

Die Motivation für die Entwicklung hochautomatisierter Systeme zur Erkennung und Aufklärung von CBE-Gefahrenlagen in unstrukturierten Umgebungen ist von entscheidender Bedeutung für eine effektive Krisenbewältigung und den Schutz von Leben. Besonders in Großschadenslagen, bei der Gefahrenabwehr oder humanitären Hilfslieferungen ist es von größter Wichtigkeit, schnell und präzise über die Lage informiert zu sein.

Das Ziel ist es, teleoperierte oder autonome Erkundungsmöglichkeiten in Krisenszenarien und Gefahrensituationen zu realisieren. Dabei steht die Umsetzung einer datenzentrierten Technologie im Fokus.

Hierbei wird im MUSERO Projekt das SHERP Fahrzeug mit einer Laserspektroskopie zur Substanz-Klassifizierung ausgestattet. Ein wesentlicher Aspekt ist die Berücksichtigung von schwachen Messgrößen und Indikatoren in einer Gesamtbewertung. Dies ermöglicht eine präzise und zuverlässige Analyse der Lage, selbst unter schwierigen Bedingungen. Letztendlich zielt dieses Vorhaben darauf ab, den Schutz von Einsatzkräften zu verbessern und die Effizienz bei der Bewältigung von Krisensituationen zu steigern.

DLR Partner:

Institut für Raumfahrtantriebe

Institut für Technische Physik

Institut für Robotik und Mechatronik

Institut für Softwaretechnologie

Link: https://elib.dlr.de/198281/1/Musero_Poster_vfdb_2023.pdf

Projekt-4: iFOODis

iFOODis – Improving the sustainability of food cycles through intelligent (robotic) systems

Das iFOODis Projekt ist von der HGF im Rahmen der Gand Challanges Kampagne durch ein experten Gremium ausgewählt und gefördert worden.

Laufzeit: 1.01.2022 – 31.12.2027

Budget: 11 M€

iFOODis trägt zur Verbesserung einer nachhaltigen Lebensmittelproduktion bei, indem es ein intelligentes robotergestütztes Überwachungsnetz für die kontinuierliche Bewertung des Zustands von Ökosystemen an Land und in Oberflächengewässern im Zusammenhang mit landwirtschaftlichen Tätigkeiten einrichtet. Die synoptische Beobachtung des Zustands von Nahrungsmittelpflanzen, landwirtschaftlicher Tätigkeit und Umweltparametern in der Atmosphäre, auf dem Boden und in den Oberflächengewässern ermöglicht die Entwicklung von Managementoptionen und Empfehlungen für Behörden und politische Entscheidungsträger auf der Grundlage einer wissenschaftlich fundierten Datenbasis. Um dieses Ziel zu erreichen befasst sich iFOODis mit der Entwicklung und Anwendung von sowohl satellitenbasierter Fernerkundungsmethoden als auch von Roboter- und Sensornetzwerken in der Luft, am Boden und im Wasser. Die Entwicklungen umfassen Methoden der Datenakquise und Interpretation, der robotischen semantischen Navigation und Exploration, der autonomen Probennahme und Sensoraufstellung, der robusten drahtlosen Kommunikation, Abstandsmessung und Zeitsynchronisierung, als auch des Datenmanagements um relevante Daten effizient zu sammeln und mit ihrer Hilfe ein umfassendes Lagebild zu erstellen und zu verbessern.

Das iFOODis Netzwerk wird für drei Anwendungsfelder vorgesehen und richtet sich dabei an den „Sustainability Development Goals (SDGs)“ des „United Nations Development Programs (UNDP)“ sowie an den Vorgaben der internationalen Gremien für Meeresschutz aus. Die erste Anwendung des iFOODis-Netzwerks ist für die Schlei-Region (Ostsee, Deutschland) geplant, die zu einem der am stärksten von der Landwirtschaft beeinflussten Gebiete gehört. Wir streben eine hohe und kosteneffiziente Übertragbarkeit des iFOODis-Netzwerks auf andere Regionen an. Die Empfehlungen werden z.B. Maßnahmen zur Verbesserung der Gesundheit von Ökosystemen in Land und Wasser, Ressourceneffizienz, Strategien für Landnutzung und Fischerei betreffen. Ein weiterer Schwerpunkt ist der ferngesteuerte Transport von Lebensmitteln und Material in überschwemmten, rauen und schwer zugänglichen Regionen, in denen die Bedingungen für menschliche Fahrer gefährlich sein könnten. Ein dritter Anwendungsfall von intelligenten Robotern und Überwachungsnetzwerken ist schließlich der wachsende Bereich der kommerziellen Agrarrobotik in der Landbewirtschaftung und Landwirtschaft. Spezifische Themen in den Bereichen Robotik, Daten- und Agrar-/Umweltwissenschaften werden in der iFOODis-Graduiertenschule an der MUDS und JUB behandelt. iFOODis zielt auf einen hohen Technologie- und Wissenstransfer in die Industrie im Bereich der Robotik und der intelligenten Datenverarbeitung und verfolgt eine Open-Access-Datenpolitik.

Die AHEAD aktivität wird im iFOODis Projekt primär im zweiten Anwendungsscenario unterstütz.

Partner:

Das Deutsche Zentrum für Luft- und Raumfahrt ist das Forschungszentrum der Bundesrepublik Deutschland für Luft- und Raumfahrt, Energie, Verkehr, Digitalisierung und Sicherheit im Bereich der angewandten Wissenschaften und der Grundlagenforschung. In iFOODis sind folgende Insitute beteiligt:

Das Alfred-Wegener-Institut, Helmholtz-Zentrum für Polar- und Meeresforschung, ist eine international anerkannte Forschungseinrichtung in Bremerhaven, die sich auf die Erforschung der Polargebiete und der sie umgebenden Meere spezialisiert hat. Es ist eine der wenigen wissenschaftlichen Einrichtungen weltweit, die sich sowohl auf die Arktis als auch auf die Antarktis spezialisiert haben.

Constructor University (Former JUB – Jacobs University Bremen gGmbH) is a private, English-speaking campus university in Germany with the highest standards in research and teaching following an interdisciplinary concept. With the aim of strengthening people and markets with innovative solutions and advanced training programs.

In der Munich School for Data Science MUDS haben sich die Technische Universität und die Ludwig-Maximilians-Universität München sowie das Helmholtz Zentrum München (HMGU) und das Deutsche Zentrum für Luft- und Raumfahrt (DLR) mit dem Max-Planck-Institut für Plasmaphysik zu einem international sichtbaren und hoch attraktiven Forschungsverbund zusammengeschlossen. Die MUDS kooperiert außerdem mit dem Leibniz-Rechenzentrum (LRZ) und der Max Planck Computing & Data Facility (MPCDF) und arbeitet mit Roche Penzberg, Boehringer und anderen Industriepartnern zusammen, um anwendungsorientierte Promotionsprojekte in der Biomedizin zu fördern.

Neben den oben genannten Kernforschungspartnern sind auch Industrieunternehmen, Behörden und öffentliche Einrichtungen, darunter das Welternährungsprogramm, Mitglieder der Projektarbeitsgruppe.

Projekt-5: RESITEK

Das Projekt RESITEK ist ein Förderprojekt im Rahmen der DLR internen FuE finanzierten Impulse aus dem Jahre 2024

Laufzeit: 1.01.2024 – 31.12.2026

Budget: 10 M€

Katastrophenereignisse stellen den Zivil- und Katastrophenschutz vor große Herausforderungen unter anderem hinsichtlich a) Verfügbarkeit von Kommunikationsverbindungen, b) Verfügbarkeit von aktuellen Daten zur Lageerfassung und -einschätzung, v.a. auch in Hinblick auf betroffene kritische Infrastrukturen und c) Zugänglichkeit des Katastrophengebietes trotz zerstörter Infrastruktur sowie sicherer Transport von Gütern in/aus Katastrophengebieten.

Das Projekt RESITEK möchte daher die Fähigkeiten und Technologien des DLR aus den Schwerpunkten Luftfahrt, Raumfahrt, Energie, Verkehr und Sicherheit bündeln, um Technologien und Dienste in ein Daten- & Visualisierungssystem einzubinden. Auf Basis dieses Systems soll ein konstantes Lagemonitoring möglich sein und zudem im Katastrophenfall eine anwenderorientierte und einsatzoptimierte Lagebilderfassung, Einsatzplanung und -durchführung ermöglicht werden. Das Daten- und Visualisierungssystem soll alle relevanten Daten sammeln und analysieren, um so Handlungsempfehlungen für eine normale Lage zu geben und im Katastrophenfall den Hilfseinsatz der Behörden und Organisationen mit Sicherheitsaufgaben (BOS) so effizient und schnell wie möglich zu gestalten. In einer gemeinsamen Abschlussdemonstration soll dann das Zusammenspiel der entwickelten Plattformen mit unterschiedlichsten Einsatzvehikeln (Boden und Luft, bemannt und unbemannt) in einem realitätsnahen Einsatzszenario mit Behörden und Stakeholdern demonstriert werden.

Daraus ergibt sich für das Projekt RESITEK eine szenarien- und nutzeroffene Betrachtungsweise und die Anforderung, ein modulares und stetig erweiterbares Gesamtsystem zu entwickeln. Innerhalb des Projektes werden hierzu folgende thematische Schwerpunkte betrachtet: a) Weltraumwetter (Auswirkungen auf Menschen und Energieinfrastruktur), b) Resilienz von Stromnetzen (Schaffung von Inselnetzen), c) Mobilität in Sondersituationen (Nutzung batterieelektrischer KFZ für Netze, Flucht und Zugänglichkeit), d) Fernführung und Missionsplanung (inkl. Kommunikation und Navigation) und e) komplexes Lagebild (auf Basis verschiedenster Einsatzvehikel).

DLR Partner:

Deutsches Fernerkundungsdatenzentrum

Institut für Flugführung

Institut für Flugsystemtechnik

Galileo Kompetenzzentrum

Institut für KI-Sicherheit

Institut für Kommunikation und Navigation

Institut für Luft- und Raumfahrtmedizin

Institut für Materialphysik im Weltraum

Institut für Optische Sensorsysteme

Institut für Physik der Atmosphäre

Institut für den Schutz terrestrischer Infrastrukturen

Institut für Robotik und Mechatronik

Institut für Solar-Terrestrische Physik

Institut für Systemdynamik und Regelungstechnik

Institut für Verkehrssystemtechnik

Institut für Vernetzte Energiesysteme

Institut für Verkehrsforschung